13回のツイートを連続して送信してください!

Openai Super Alignment LeaderJan Leike、つまり、イリヤを追って会社を去ったばかりの人は、彼の辞任とより多くの内部情報の本当の理由を明らかにしました。

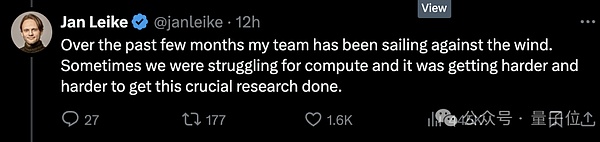

まず第一に、コンピューティング能力は十分ではありません、スーパーアライメントチームに20%の不足を与えることを約束し、チームが現在のところに反対しますが、ますます困難になっています。

第二に、安全性は真剣に受け止められていません、AGIのセキュリティガバナンスの問題の優先事項は、「光沢のある製品」を立ち上げるほど良くありません。

その後すぐに、他の人にもっと多くのゴシップが掘り出されました。

たとえば、OpenAIのすべてのメンバーは契約に署名する必要があります。仕事を辞めた後、Openaiについて悪いことを言わないようにしてください、署名しない場合、会社の株式を自動的に放棄するとみなされます。

しかし、サインアウトし、重いニュースを出すことを拒否する硬い骨(死に至る)があり、中核的なリーダーシップは長い間セキュリティ問題の優先順位に分けられてきたと述べています。

昨年の宮殿の戦い以来、2つの派ions間の対立は重要なポイントに達し、それからかなりきちんと崩壊するようです。

したがって、Ultramanは共同設立者を派遣してSuper Alignmentチームを引き継ぎましたが、外の世界にはまだ好まれていません。

最前線にいたTwitterのネチズンは、この驚くべきメロンとため息をつく勇気を持っていることに1月に感謝しました。

私はそれを拾うだけです、それはオープンアイが本当にこのセキュリティにあまり注意を払っていないようです!

しかし、振り返ってみると、現在Openaiを担当しているUltramanは、当分の間まだじっと座ることができます。

彼は、Openaiの非常に協力と安全への貢献にJanに感謝するために立ち上がって、彼は実際には非常に悲しく、去ることに消極的だと言いました。

もちろん、ポイントは実際にこの文です:

待って、私は2日で長いツイートを投稿します。

約束された20%のコンピューティングパワーには、実際に大きなケーキを塗装する成分があります

昨年のオープン宮殿の戦いから現在まで、魂の姿と元チーフサイエンティストのイリヤは、ほとんど公の姿を出したり、声を出したりしたことはほとんどありません。

彼が公に辞任すると主張する前に、多くの異なる意見がありました。多くの人々は、イリヤが人間を破壊する可能性のあるAIシステムなど、いくつかのひどいものを見てきたと考えています。

△ネチズン:私が毎日目を覚ますときに最初にやることは、イリヤが見ていることを考えていることです

今回、ヤンは青から外れていましたが、核となる理由は、技術パーティーと市場党のセキュリティの優先レベルが異なる意見を持っていたということでした。

違いは非常に深刻であり、結果は現在です…誰もがそれらを見てきました。

Voxによると、Openaiに精通している情報筋はそれを明らかにしました安全にもっと集中する従業員はウルトラマンに対する自信を失っています、「これは少しずつ信頼のプロセスです。」

しかし、あなたが見ることができるように、公共のプラットフォームや機会に、多くの従業員がこの問題について公に話すことをいとわない。

その理由の一部は、オープンは常に従業員に非控除契約と辞任契約に署名するという伝統。署名を拒否した場合、それはあなたが以前に入手したOpenAIオプションをあきらめたことを意味します。これは、話をするために出てくる従業員が膨大な金額を失う可能性があることを意味します。

しかし、ドミノはまだ1つずつ落ちました –

イリヤの辞任により、Openaiの最近の辞任の波が強化されました。

彼の辞任の発表に続いて、少なくとも5人のセキュリティチームメンバーが続きますが、スーパーアライメントチームの長であるJanを除きました。

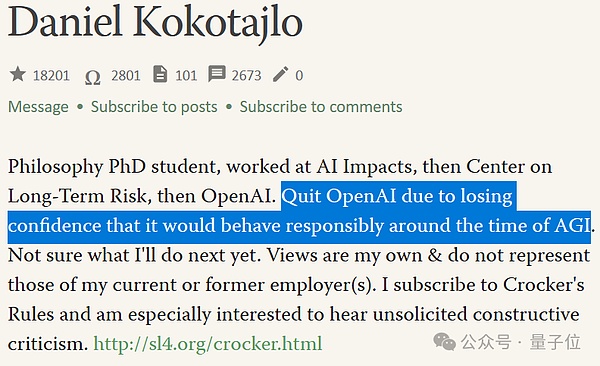

その中には、非抑制契約に署名していない別の硬い骨、ダニエルココタジロ(以下、DKブラザーと呼ばれる)があります。

昨年、DKはAIの生存災害の可能性は70%であると信じていると書いています

兄弟DKは2022年にOpenaiに参加し、彼の主な仕事で働いていました。

しかし、彼は最近辞任し、インタビューを受けました:

Openaiは、最終的に人間の知性を上回ることを目的として、より強力なAIシステムをトレーニングしています。

これは、人類に起こったことがある最高のことかもしれませんが、偶然行動すれば最悪かもしれません。

DK兄弟は、彼がOpenaiに入社したとき、彼は復venとセキュリティガバナンスへの希望に満ちていたと説明し、OpenaiがAGIに近づくほど責任があることを望んでいました。しかし、チームで多くの人々私は徐々に、Openaiがこんな感じではないことに気づきました。

「私は徐々にオープンのリーダーシップとAGIを責任を持って処理する能力を失いました。」

将来のAGIの安全作業に失望することは、誰もがイリヤによる激しい出発の波に去った理由の一部です。

理由の別の部分はです超整合したチームは、おそらく、外の世界が想像するほど豊富なリソースで研究を行うことができないでしょう。

スーパーアライメントチームがフル能力で働いていても、チームはOpenaiによって約束されたコンピューティングパワーの20%しか得られません。

そして、チームからのいくつかの要求はしばしば拒否されます。

もちろん、コンピューティングリソースはAI企業にとって非常に重要であり、すべてのポイントが合理的に割り当てられなければならないためです。

言い換えれば、Super Alignmentチームは、Openaiが直面する必要がある将来のセキュリティの問題に対応しています。重要なポイントは将来であり、それが現れるかどうかはわかりません。

報道時間の時点で、Ultramanは彼の「長いツイート(Janのインサイダーより)」をリリースしていません。

しかし、彼は、セキュリティの問題に関するヤンの懸念が正しいと簡単に述べました。「やることがたくさんあります。」

この点で、誰もが最初に小さなスツールをセットアップできるので、できるだけ早くメロンを一緒に食べましょう。

要約すると、スーパーアライメントされたチームは多くの人々、特にイリヤとヤンの辞任を残しました。

フォローアップの取り決めはです共同設立者のジョン・シュルマが引き継ぎます、しかし、もはや献身的なチームはありません。

新しいスーパーアラインメントチームは、メンバーが会社のさまざまな部門に広がっているゆるやかな接続チームになります。

これは、外の世界によっても疑問視されていますジョンのオリジナルのフルタイムの仕事は、現在のOpenai製品のセキュリティを確保することでした。

ジョンは突然より多くの責任を負い、現在および将来のセキュリティの問題に注意を払う2つのチームをリードした後、忙しいのだろうか?

イリヤ・アルトマン間の戦い

タイムラインが延長された場合、今日のfallバラバラは、実際にはオープンの「パレスファイト」イリヤアルトマンの戦いの続編です。

昨年11月、イリヤがまだそこにいたとき、彼はオープン士の取締役会と協力してウルトラマンを解雇しようとしました。

当時与えられた理由は、彼がコミュニケーションに誠実ではなかったからです。言い換えれば、私たちは彼を信用していません。

しかし、最終的な結果は明らかです。イリヤはボードを去ります。一方、ウルトラマンは、取締役会に参加するためにより有益なメンバーを選びました。

その後、イリヤは数日前に辞任を正式に発表するまで、ソーシャルプラットフォームから再び姿を消しました。そして、それは約6か月間Openaiオフィスに登場していないと言われています。

彼は当時興味深いツイートを残しましたが、すぐに削除されました。

私は先月多くの教訓を学びました。教訓の1つは、「士気が改善されるまでbeat打が続く」というフレーズが、本来よりも頻繁に適用されるということです。

しかし、インサイダーによると、Ilyaは、スーパーアラインメントチームをリモートで共同リードしています。

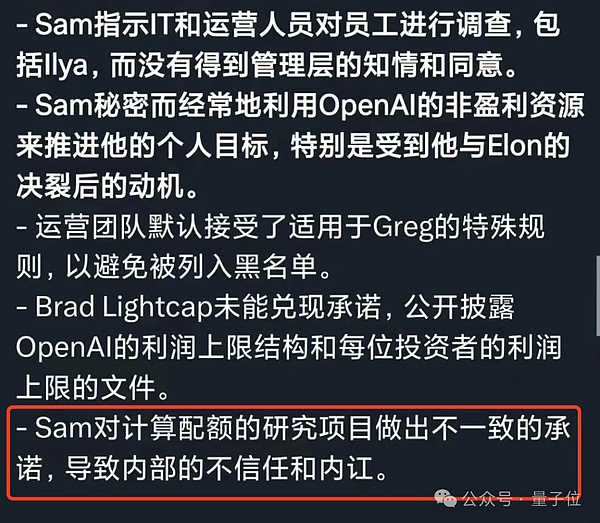

ウルトラマンの側では、彼の従業員からの最大の告発は、彼が言葉や行為に反対していたということでした。

当初約束されたコンピューティングリソースが与えられていないことを除きます。また、サウジアラビアなどに、しばらく前にコアを構築するための資金を調達するように頼むなどの質問もあります。

これらの安全指向の従業員は混乱していました。

彼が本当に安全な方法で人工知能を構築して展開することを本当に気にしているなら、彼はテクノロジーの開発を加速するために非常に必死にチップを蓄積しませんか?

以前、OpenaiはUltramanが投資したスタートアップからチップを注文しました。金額は5,100万米ドル(約3億6,000万人民元)です。

宮殿の戦闘中の元Openaiの従業員からの報告書では、ウルトラマンの説明が再び確認されたようです。

まさにこのためです最初から最後まで、「異なる言葉と行為」この操作は、OpenaiとUltramanに対する自信を徐々に失いました。

Ilyaはこのようなもので、Jan Laikeはこのようなもので、Super Alignチームもそうです。

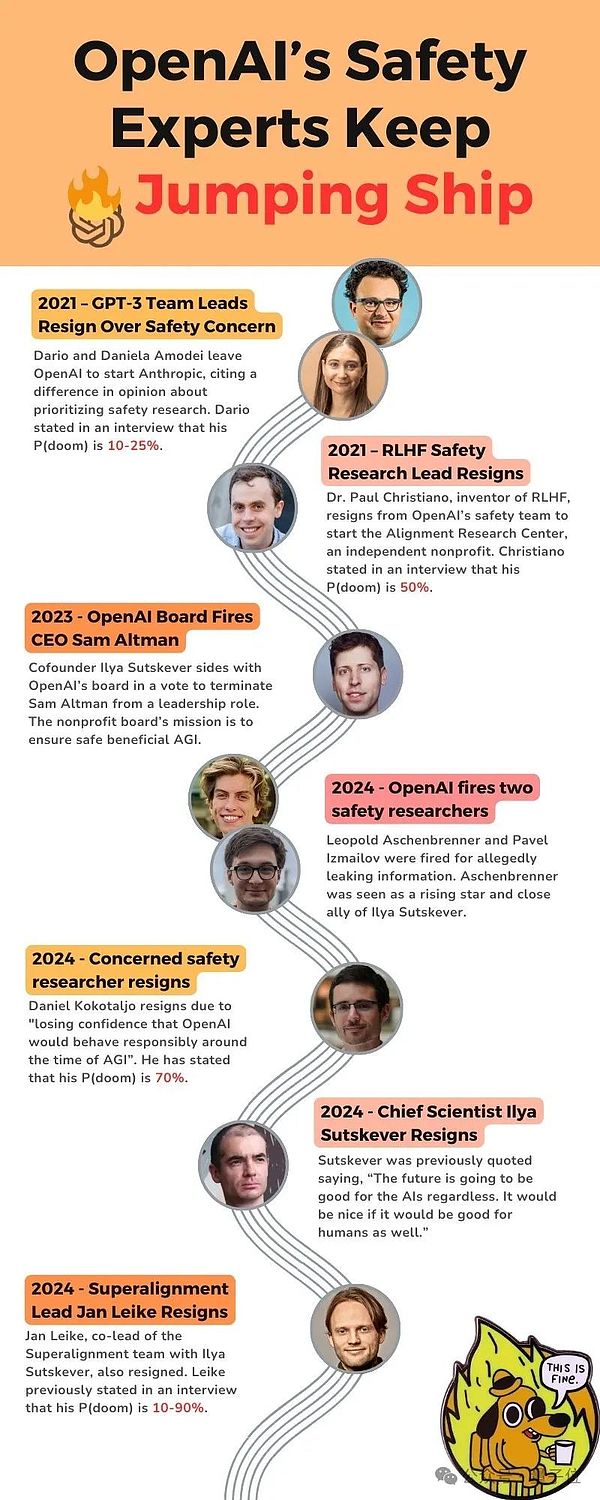

いくつかの思いやりのあるネチズンは、過去数年間に起こった関連することの重要なノードを整理しました – 以下に言及したように、最初に思いやりのあるリマインダーを与えますP(DOOM)、「AIが終末のシナリオをトリガーする可能性」を指します。

2021年、GPT-3チームの長は「安全」の問題のためにOpenaiを去り、そのうちの1人はP(Doom)が10-25%であると信じていました。

2021年、RLHFセキュリティ研究の長が辞任し、P(DOOM)は50%でした。

2023年、Openaiの取締役会はウルトラマンを解雇しました。

2024年、Openaiは2人のセキュリティ研究者を解雇しました。

2024年、セキュリティが残っていることを特に懸念しているOpenaiの研究者であり、P(DOOM)はすでに70%であると考えています。

2024年、イリヤとヤン・ライケは辞任しました。

技術または市場?

大きなモデルの開発以来、「AGIを実装する方法」は、実際には2つのルートに起因する可能性があります。

専門学校このテクノロジーが成熟して制御可能であり、その後適用できることを願っています。市場開かれている間、「漸進的な」アプローチの適用が終わりに達したと考えられています。

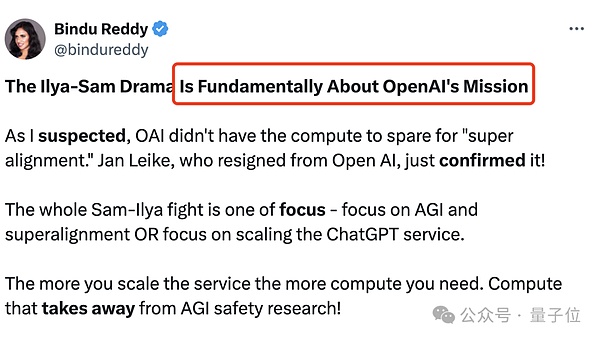

これは、イリヤ・アルトマンの紛争、つまりオープンの使命の根本的な違いでもあります。

AGIとスーパーアラインメントに焦点を当てるか、ChatGPTサービスの拡張に焦点を当てますか?

ChatGPTサービスが大きいほど、これにはAGIセキュリティ調査に時間がかかります。

Openaiが研究専用の非営利団体である場合、彼らは超整合にもっと時間を費やすべきです。

Openaiによるいくつかの外部測定から判断すると、結果は明らかにそうではありません。彼らは、ビッグモデルの競争で主導権を握り、企業や消費者により多くのサービスを提供したいだけです。

イリヤの意見では、これは非常に危険なことです。スケールが成長するにつれて何が起こるかわからなくても、イリヤの意見では、最良の方法は最初に安全であることです。

私たち人間が秘密の方法ではなく安全に建設されることを保証できるように、オープンで透明になります。

しかし、ウルトラマンのリーダーシップの下で、Openaiはオープンソースでも非常に協力的でもないようです。代わりに、堀を作ろうとしている間、AGIに向かって走ることがすべてでした。

結局、AIの科学者イリヤの選択は正しかったのですか、それともシリコンバレーのビジネスマンであるウルトラマンが最後に行くことができますか?

今知る方法はありません。しかし、少なくともOpenaiは現在、重要な選択に直面しています。

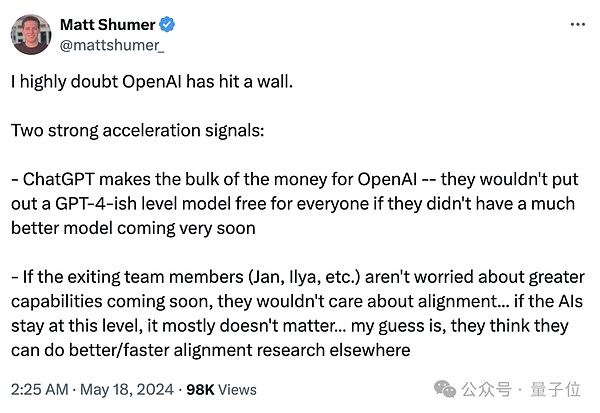

一部の業界関係者は、2つの重要なシグナルを要約しています。

1つそれは、より良いモデルサポートなしで、GPT-4が無料で提供されることはありません。

別のつまり、辞任したチームメンバー(Jan、Ilyaなど)がすぐにより強力な機能の可能性を心配していない場合、彼らはアラインメントを気にしません… AIがこのレベルにとどまる場合、それは基本的に問題ではありません。

しかし、Openaiの基本的な矛盾は解決されていません。AI科学者はAGIの責任ある発展を心配しており、他方では、シリコンバレー市場は商業化を通じて技術的な持続可能性を促進するように促されています。

両側はもはや和解できず、科学派factはオープンイから完全に排除されており、外の世界はまだGPTがどこに到達したかをまだ知りませんか?

この質問に対する答えを知りたがっている人々は、少し疲れていました。

イリヤの教師であり3つのチューリング賞の1人であるヒントンが言ったように、私の心に無力感が急増しました。

私は年をとっていて心配していますが、それについて何もできません。

参照リンク:

[1] https://www.vox.com/future-perfect/2024/5/17/24158403/openai-resinations-ai-safety-ilya-sutskever-jan-leike-artificial-intelligence

[2] https://x.com/janleike/status/1791498174659715494

[3] https://twitter.com/sama/status/1791543264090472660