Die Auferstehung von Wolken und Algament -im Namen der KI

Mode ist ein Zyklus, ebenso wie Web 3.

In der Nähe von „Re -“ wurde eine öffentliche Ki. Siedlung von IO.net, Bittensor, Render -Netzwerk.

Wenn wir unsere Aussagen erhöhen, während der Preis der Währung steigt, können wir einige interessante Fakten finden:

-

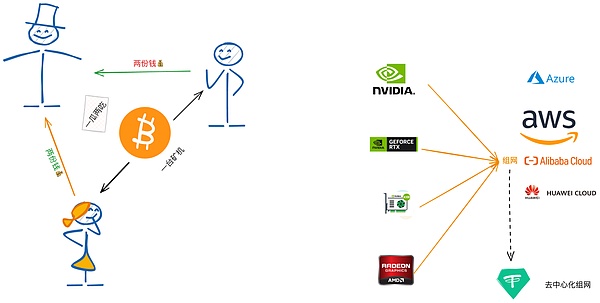

Der Streit zwischen der GPU -Rechenleistung erfolgt auf die dezentrale Plattform.

-

Das Berechnungsparadigma von wolkig zu Dezentralisierungsübergängen, hinter den Bedürfnissen des KI -Trainings bis zum Denken, ist das Modell in der Kette nicht mehr die Rede von Kong Xuan.

-

Die zugrunde liegende Software- und Hardware -Komposition und Betriebslogik der Internetarchitektur haben sich nicht grundlegend geändert, und die dezentrale Berechnungskraftschicht hat mehr Anreize für die Vernetzung.

-

Die Anzahl der Hardware wie die GPU, dh nach Mooreschen Gesetz, dh die Berechnungsleistung der neuen GPU, desto stärker ist die Berechnungsleistung, desto stärker ist die Berechnungsleistung.

-

Die organisatorische Methode der Anreizschicht, die zu den Branchenmerkmalen der Web3, der Doppelgeneration, der kanadischen Regulierungsfunktionen, der Airdrop -Anreizmaßnahmen usw. gehört, die den langfristigen Wert jedes Projekts leichter verstehen können, anstatt über – Zahlen des kurzfristigen Währungspreises.

-

Einreicher: Task -Initiator, letztendlich für Schulungskosten bezahlen.

-

Löser: Trainingsmodelle und liefert einen effektiven Beweis.

-

Prüfer: Überprüfung der Modellwirksamkeit.

-

Whistleblowers: Überprüfen Sie die Arbeit der Überprüfung.

Das Konzept der fortgeschrittenen Konzepte, die Cloud Albon Power der Web3 World wurde in der Zeit des Cloud -Mining geboren, das sich auf die Verpackung der Rechenleistung der Bergbaumaschine bezieht, um enorme Ausgaben für Benutzer zum Kauf von Bergbaumaschinen zu vermeiden, aber Rechenleistung Hersteller „überverkauft“, wie z. B. Supermarkte, wie Supermarkting, wie Supermarkte, wie das Supermarkting, wie das Mischen der Rechenleistung von 100 Ore -Maschinen an 105 Personen, um überschüssige Renditen zu erzielen, und schließlich entspricht das Wort der Täuschung.

Die Cloud -Algament -Leistung in diesem Artikel bezieht sich speziell auf die Rechenleistung von Cloud -Herstellern, die auf der GPU basieren.

Die Kombination von herkömmlichen Cloud -Herstellern und Blockchain ist tiefer als wir uns vorstellen. Über extreme Umstände kann das Netzwerkkabel nicht ignoriert werden.

Auf der anderen Seite erstellt die dezentrale Computerleistungsplattform entweder direkt einen „Computerraum“, um die Stabilität des Netzwerks aufrechtzuerhalten oder direkt ein Anreiznetzwerk wie IO.NETs leere GPU -Mengenstrategie von IO.NET zu erstellen, genau wie das Speicher -Fil -Token von Filecoin, die Der Ausgangspunkt ist nicht, die Bedürfnisse der Verwendung zu erfüllen, sondern die Token zu befähigen. Ressourcen.

Angesichts der hohen Währungspreise und FOMO -Emotionen sind alle Anschuldigungen der dezentralen Rechenleistung verschwunden.

>

Argumentation und Flops, quantitative GPU -Rechenleistung

Die Rechenleistungspflicht des KI -Modells entwickeln sich von der Ausbildung zum Argumentation.

Nehmen wir als Beispiel OpenAIs Sora. Die für weniger Parameter erforderlichen Rechenressourcen sind ebenfalls eine Dämpfung.

Sora benötigt jedoch möglicherweise eine stärkere „Argumentation“. wird nach dem vorhandenen Inhalt zusammengefasst, und die Berechnungsleistung ohne Gehirn hat ein Wunder.

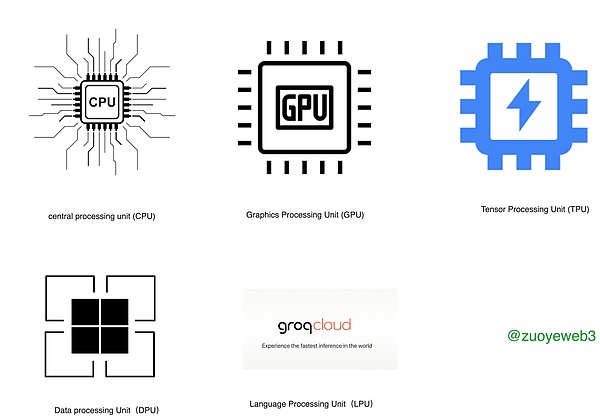

In der vorherigen Phase wurde die AI -Rechenleistung hauptsächlich für das Training eingesetzt, ein kleiner Teil wurde für die Argumentationsfunktionen verwendet und im Grunde genommen von verschiedenen Produkten von NVIDIA zusammengefasst. Die Logik des Gehirns wird langsam zum Mainstream.

Darüber hinaus wird die Klassifizierung der GPU hinzugefügt. Wie 4090 Grafikkarten, Spiele und Spiele des Spielens. Computer zu speziellen Bergbaumaschinen.

>

Mit der Reife und dem Fortschritt der KI -Technologie, insbesondere der LLM -Route, werden die TPUs, DPUs und LPUs, immer mehr sein. , was Zeit braucht, um es vollständig zu ersetzen.

Der dezentrale Computer -Leistungswettbewerb kämpft nicht für den Pick -UP -Kanal der GPU, sondern versucht, ein neues Gewinnmodell aufzubauen.

Zu diesem Zeitpunkt ist Nvidia fast der Protagonist, und es ist im Grunde genommen Nvidia -Anteil an 80% des Grafikkartenmarktes.

Die absolute Monopolposition hat den großen Anlass für jede Familie zum Kämpfen für die GPU zum Kämpfen von RTX 4090 bis zur A100/H100 der Enterprise -Level geschaffen.Google, Meta, Tesla und OpenAI beteiligten sich jedoch mit ihren eigenen Chips oder Plänen.

Für herkömmliche Cloud -Hersteller ist der Verkauf tatsächlich den Strom- und Speicherplatz.

Da sich das Ethereum an POS verwandelt, ist die Spezialhardware des Währungskreises immer weniger geworden. AI Computing Power Cards für dedizierte AI -Computer -Power -Karten aus einer web3 -charakteristischen Straße.

Ist die dezentrale Rechenleistung im nächsten Schritt der Wolke oder der Ergänzung.

Die Rechenleistung der GPU wird in der Regel mit Flops verglichen (schwimmende Punkte pro Sekunde, die Anzahl der schwimmenden Punkte pro Sekunde). Dies ist der am häufigsten verwendete Indikator für die Berechnungsgeschwindigkeit.

Von der lokalen Berechnung nach Shangyun ist es in etwa einem halben Jahrhundert, und das von LLM angetriebene Verteilungskonzept ist nicht so illusorisch wie zuvor. So viel wie möglich beträgt die Inspektionsdimension nur zwei Punkte:

Aus dieser Perspektive basiert die dezentrale Rechenleistung immer noch auf der Depin -Route des „vorhandenen Hardware+-Netzwerks“, oder die Internetarchitektur ist weiterhin die untere Ebene. .

Die Rechenleistung sollte dezentralisiert werden, und die GPU muss zentralisiert sein

Mit dem drei Dilemma der Blockchain muss die Sicherheit der dezentralen Rechenleistung nicht speziell sein, hauptsächlich Dezentralisierung und Skalierbarkeit, letzteres ist der Zweck des GPU -Netzwerks nach dem Netzwerknetzwerk.

Ausgehend von einem Paradoxon, wenn das dezentrale Rechenleistungsprojekt durchgeführt werden will, sollte die Anzahl der GPUs im Netzwerk so weit wie möglich sein.

Natürlich können dezentrale Rechenleistungsprojekte im Vergleich zu der absoluten Kontrolle der Cloud -Hersteller im aktuellen Stadium mindestens keinen genauen Einstieg und die kostenlosen Migrations -GPU -Ressourcen einrichten.

In der Skalierbarkeit kann die GPU nicht nur für KI verwendet werden, sondern auch für Cloud -Computer und das Rendering sind auch machbare Pfade.

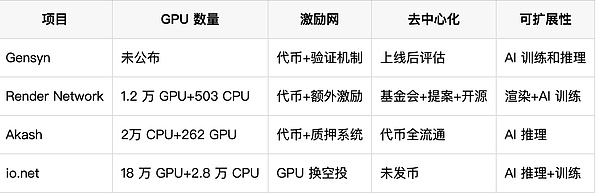

Daher können zwei Parameter außerhalb des GPU und des Incentive -Netzwerks hinzugefügt werden, die eine Dezentralisierung und Skalierbarkeit sind, die einen Vergleichsindikator für vier Winkel bildet.

In den obigen Projekten ist das Rendernetzwerk tatsächlich ein verteiltes Rendering -Netzwerk. wie umgekehrte Kommunikation, aber Rendering und andere Aufgaben müssen dies nicht tun.

Die KI -Trainingsfunktionen sind hauptsächlich mit IO.NET verbunden. als Rendern von Netzwerken.

Zweitens listet die offizielle Website von IO.NET von GPU -Entwicklungsrouten auf. Das Training gehört zum Weg zur Arbeit.

In streng genommen ist das KI -Training nicht für die verteilte Bereitstellung geeignet. Weitere Datenschutz- und Verschlüsselungsvorgänge wie Technologien wie ZK und FHE und AI -Argumentation Web 3 sind vielversprechend. bestimmter Verlust.

Filecoin, ein weiterer Bergbau zu den Token, hat auch eine GPU -Nutzungsvereinbarung mit IO.NET erreicht

Wiederum kommen wir auch die Cloud -Bewertung Persönlich sind die Anzahl der GPUs mit hoher Leistung nicht weniger Anforderungen an die Anzahl der GPUs mit hoher Performance. wird im Design spezifischer Mechanismen komplizierter sein.

Insbesondere muss Genyn die Effektivität des Modelltrainings sicherstellen.

Insgesamt ist die Betriebsmethode dem POW -Mining+ optimistischer Beweismechanismus. Die Struktur ist sehr kompliziert. Ich wünsche Gensyn auch viel Glück hier.

Schließlich konzentriert sich der alte Akash von Akash, der mit dem Render -Netzwerk beginnt.

Der Schlüssel zu Akashs Verjüngung des neuen Jahres besteht darin, das Mine zu sehen, das das Mine -Problem stammt. Gemeinsam tragen sie zur menschlichen Zivilisation bei.

Akash hat jedoch den Vorteil, dass die Token im Grunde genommen zirkulieren.

Darüber hinaus gibt es die Theta des Edge Cloud Computing, das Phönix der Lösung der AI -Rechenleistung bietet und alte und neue kostbare Berechnungen wie Bittersor und Ritual berechnet.

Abschluss

Während der gesamten Historie der Computerentwicklung können alle Arten von Computerparadigmen erstellt werden, und es ist das einzige Bedauern, dass sie keine Auswirkungen auf die Mainstream -Anwendungen haben. von Transformator, nicht in der Nähe von Gründer.

Was ist noch pessimistischer, dass die Skala des aktuellen Cloud -Computing -Marktes und die Spieler zu leistungsfähig sind. zugrunde liegende Komponente.

In gewissem Sinne ist die Macht von Open Source und Dezentralisierung konsistent, und die dezentralen Projekte sind in den Finanzfeldern wie Defi übermäßig konzentriert, und KI kann ein wichtiger Weg sein, um in den Mainstream -Markt einzuschalten.