إرسال 13 تغريدة على التوالي!

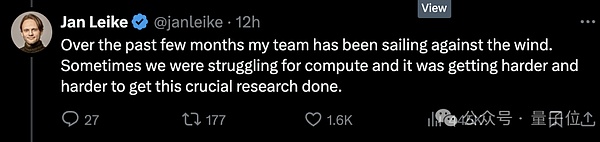

زعيم محاذاة سوبر Openaiجان ليك، أي الشخص الذي تبع ILYA للتو لمغادرة الشركة ، كشف عن السبب الحقيقي لاستقالته والمزيد من المعلومات الداخلية.

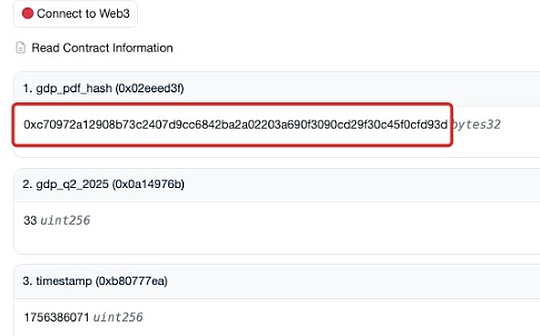

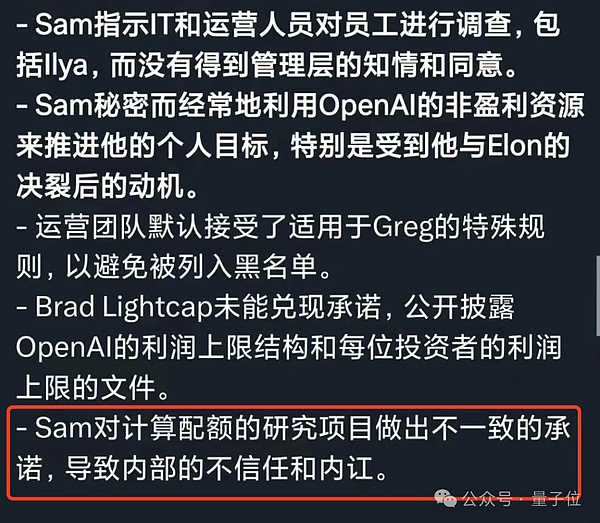

بادئ ذي بدء ، لا توجد قوة حوسبة كافية، ووعد بإعطاء فريق محاذاة فائقة النقص بنسبة 20 ٪ ، مما تسبب في مواجهة التيار ، ولكن أصبح الأمر صعبًا بشكل متزايد.

ثانيا ، السلامة لا تؤخذ على محمل الجد، أولوية قضايا الحوكمة الأمنية في AGI ليست جيدة مثل إطلاق “منتج لامع”.

بعد ذلك مباشرة ، تم حفر المزيد من القيل والقال من قبل الآخرين.

على سبيل المثال ، يتعين على جميع أعضاء Openai توقيع اتفاق.تأكد من أنك لا تقول أشياء سيئة عن Openai بعد مغادرة وظيفتك، إذا لم تقم بالتوقيع ، فسيتم اعتبارك التخلي تلقائيًا عن أسهم الشركة.

ولكن لا تزال هناك عظام صعبة ترفض تسجيل الخروج وطرح أخبار ثقيلة (تضحك حتى الموت) ، قائلين إن القيادة الأساسية قد تم تقسيمها منذ فترة طويلة على أولويات القضايا الأمنية.

منذ معركة القصر العام الماضي ، وصل الصراع بين الفصيلين إلى النقطة الحرجة ، ويبدو أنه ينهار بشكل كبير.

لذلك ، على الرغم من أن Ultraman قد أرسل مؤسسين مشاركين لتولي فريق المحاذاة الفائقة ، إلا أنه لا يزال غير مفضل من قبل العالم الخارجي.

شكر مستخدمو الإنترنت على Twitter الذين كانوا على خط المواجهة يناير على الحصول على الشجاعة للتحدث بهذه البطيخ المذهل وتنهدت:

سألتقطها فقط ، يبدو أن Openai حقًا لا يولي الكثير من الاهتمام لهذا الأمن!

لكن إذا نظرنا إلى الوراء ، لا يزال بإمكان Ultraman ، المسؤول الآن عن Openai ، الجلوس في الوقت الحالي.

وقفت ليشكر جان على مساهمته في محاذاة أوفاياي الفائقة ، وقال إنه في الواقع حزين للغاية ومتردد في المغادرة.

بالطبع ، النقطة هي في الواقع هذه الجملة:

انتظر ، سأقوم بنشر تغريدة أطول في يومين.

قوة الحوسبة الموعودة بنسبة 20 ٪ لديها في الواقع مكونات طلاء الكعك الكبير

من معركة Openai Palace في العام الماضي إلى الوقت الحاضر ، لم يسبق لك أن ظهرت شخصية Soul Soul ورئيس العلماء السابقون في ظهور أصوات علنية.

قبل أن يزعم علنا أنه يستقيل ، كانت هناك العديد من الآراء المختلفة.يعتقد الكثير من الناس أن إيليا قد شاهدت بعض الأشياء الرهيبة ، مثل نظام الذكاء الاصطناعي الذي قد يدمر البشر.

△ على الإنترنت: أول شيء أفعله كل يوم عندما أستيقظ هو التفكير فيما تراه إيليا

هذه المرة ، كان جان خارج اللون الأزرق ، والسبب الأساسي هو أن مستويات الأولوية للأحزاب الفنية وأمن حزب السوق كانت لها آراء مختلفة.

الاختلافات خطيرة للغاية ، والعواقب هي حاليا … الجميع رآهم أيضا.

وفقًا لـ Vox ، كشف مصدر مطلع على Openai ذلكفقد الموظفون الذين يركزون أكثر على السلامة الثقة في Ultraman، “هذه عملية ثقة ينهار شيئًا فشيئًا.”

ولكن كما ترون ، على المنصات العامة والمناسبات ، ليس العديد من الموظفين على استعداد للحديث عن هذا الأمر علنًا.

جزء من السبب هو أن Openai كان دائمًاتقليد جعل الموظفين يوقعون على اتفاقية الاستقالة مع اتفاقيات عدم الاستخلاص.إذا رفضت التوقيع ، فهذا يعني أنك قد تخليت عن خيار Openai الذي حصلت عليه من قبل.هذا يعني أن الموظفين الذين يخرجون للتحدث قد يخسرون مبلغًا كبيرًا من المال.

ومع ذلك ، ما زال الدومينو سقط واحدا

كثفت استقالة إيليا موجة الاستقالة الأخيرة من Openai.

تبع الإعلان عن استقالته خمسة أعضاء على الأقل من أعضاء فريق الأمن ، باستثناء يناير ، رئيس فريق المحاذاة الفائقة.

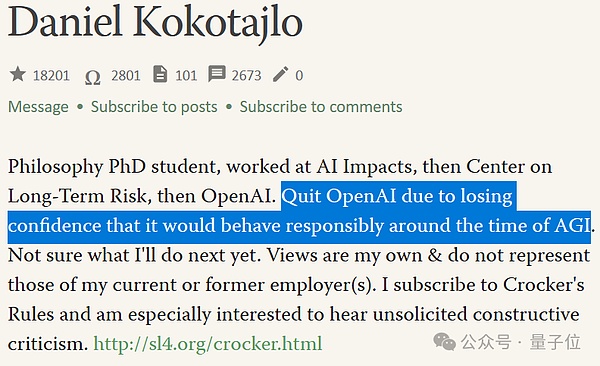

من بينهم ، هناك عظم صلب آخر لم يوقع اتفاقية عدم إجراء عملية غير محددة ، دانييل كوكوتاجلو (يشار إليها فيما يلي باسم DK Brother).

△ في العام الماضي ، كتب DK أنه يعتقد أن إمكانية كارثة البقاء على قيد الحياة في الذكاء الاصطناعي هي 70 ٪

انضم Brother DK إلى Openai في عام 2022 وعمل في فريق الحوكمة.

لكنه استقال أيضًا مؤخرًا وتم مقابلته:

يقوم Openai بتدريب أنظمة الذكاء الاصطناعى الأكثر قوة بهدف تجاوز الذكاء البشري في النهاية.

قد يكون هذا هو أفضل شيء حدث للبشرية على الإطلاق ، ولكن قد يكون الأسوأ إذا تصرفنا عن طريق الخطأ.

أوضح الأخ DK أنه عندما انضم إلى Openai ، كان مليئًا بالانتقام والأمل في الحكم الأمني ، وأعرب عن أمله في أن يكون Openai أقرب إلى Agi ، كلما كان أكثر مسؤولية.لكن في الفريقكثير من الناسأدركت تدريجياً أن Openai لن يكون هكذا.

“لقد فقدت الثقة تدريجياً في قيادة أوبريو وقدرتها على التعامل مع AGI بمسؤولية.”

خيبة الأمل من عمل السلامة في المستقبل AGI هي جزء من السبب في أن كل شخص غادر في موجة المغادرة المكثفة من قبل إيليا.

جزء آخر من السبب هومن المحتمل ألا يكون الفريق المحالف للغاية قادرًا على إجراء البحوث بموارد وفيرة كما يتخيل العالم الخارجي.

حتى لو كان الفريق المحالف للغاية يعمل بكامل طاقته ، فيمكن للفريق الحصول على 20 ٪ فقط من قوة الحوسبة التي وعدت بها Openai.

وغالبا ما يتم رفض بعض الطلبات من الفريق.

بالطبع ، لأن موارد الحوسبة مهمة للغاية بالنسبة لشركات الذكاء الاصطناعي ، ويجب تخصيص كل نقطة بشكل معقول ؛

بمعنى آخر ، يتوافق فريق المحاذاة الفائقة مع قضايا الأمان المستقبلية التي يحتاجها Openai إلى مواجهتها – النقاط الرئيسية في المستقبل ، ولا أعرف ما إذا كان سيظهر.

اعتبارًا من وقت الصحافة ، لم يصدر Ultraman “تغريدة أطول (من Jan’s Insider)”.

لكنه ذكر لفترة وجيزة أن مخاوف جان بشأن القضايا الأمنية صحيحة.“لدينا الكثير لنفعله ؛

في هذا الصدد ، يمكن للجميع إعداد براز صغير أولاً ، لذلك دعونا نأكل البطيخ معًا في أقرب وقت ممكن.

باختصار ، ترك الفريق المحاذاة الفائقة الكثير من الناس ، وخاصة استقالة إيليا وجان ، التي وضعت هذا الفريق في العاصفة في وضع صعب من كونه في قائد.

ترتيب المتابعة هوالمؤسس المشارك جون شولما يتولى المسؤولية، ولكن لم يعد هناك فريق مخصص.

سيكون فريق المحاذاة الفائق الجديد هو الفريق المتصل بالأعضاء مع أعضاء منتشرين في مختلف الأقسام المختلفة للشركة ، وقد وصفها متحدث باسم Openai بأنها “المزيد من التكامل”.

这一点也为外界所质疑,因为كانت وظيفة جون الأصلية بدوام كامل لضمان أمان منتجات Openai الحالية.

أتساءل عما إذا كان جون يمكن أن يكون مشغولاً بعد أن يتحمل فجأة المزيد من المسؤوليات وقيادة الفريقين اللذين ينتبهون إلى مشكلات الأمن الحالية والمستقبلية؟

المعركة بين إيليا ألتان

إذا تم إطالة الخط الزمني ، فإن انخفاض اليوم هو في الواقع تكملة للمعركة بين “قصر القصر” من Openai.

مرة أخرى في نوفمبر من العام الماضي ، عندما كان إيليا لا يزال هناك ، عمل مع مجلس إدارة Openai لمحاولة إطلاق Ultraman.

السبب الذي قدمه في ذلك الوقت هو أنه لم يكن صادقًا بما فيه الكفاية في التواصل.بمعنى آخر ، نحن لا نثق به.

لكن النتيجة النهائية واضحة.إيليا تغادر اللوحة.من ناحية أخرى ، اختار Ultraman الأعضاء الذين كانوا أكثر فائدة له للانضمام إلى مجلس الإدارة.

بعد ذلك ، اختفت إيليا من المنصة الاجتماعية مرة أخرى حتى أعلنت رسميًا استقالتها قبل بضعة أيام.ويقال إنه لم يظهر في مكتب Openai لمدة 6 أشهر تقريبًا.

ترك تغريدة مثيرة في ذلك الوقت ، ولكن تم حذفها بسرعة.

لقد تعلمت الكثير من الدروس خلال الشهر الماضي.أحد الدروس هو أن عبارة “الضرب ستستمر حتى تتحسن الروح المعنوية” تنطبق أكثر مما ينبغي.

ومع ذلك ، وفقا للمطلعين ،لقد شاركت إيليا في قيادة فريق المحاذاة الفائقة عن بُعد.

من جانب Ultraman ، كان أكبر اتهام من موظفيه هو أنه كان لا يوافق على الكلمات والأفعال.

باستثناء لا يتم إعطاء موارد الحوسبة الموعودة أصلاً.هناك أيضًا أشخاص طلبوا من المملكة العربية السعودية وغيرهم جمع الأموال لبناء النوى منذ فترة.

هؤلاء الموظفون الموجودون في السلامة كانوا مرتبكين.

إذا كان يهتم حقًا ببناء ونشر الذكاء الاصطناعي بطريقة آمنة قدر الإمكان ، فلن يتراكم رقائقًا بشكل محموم لتسريع تطور التكنولوجيا؟

في وقت سابق ، طلب Openai أيضًا رقائقًا من شركة ناشئة استثمرتها Ultraman.المبلغ يصل إلى 51 مليون دولار أمريكي (حوالي 360 مليون يوان).

في خطاب التقرير من موظفي Openai السابقين أثناء قتال القصر ، بدا أن وصف Ultraman تم تأكيده مرة أخرى.

إنه بسبب هذامن البداية إلى النهاية ، “كلمات وأفعال مختلفة”فقدت العملية الثقة تدريجيا في Openai و Ultraman.

Ilya مثل هذا ، Jan Laike مثل هذا ، وكذلك فريق المحاذاة الفائقة.

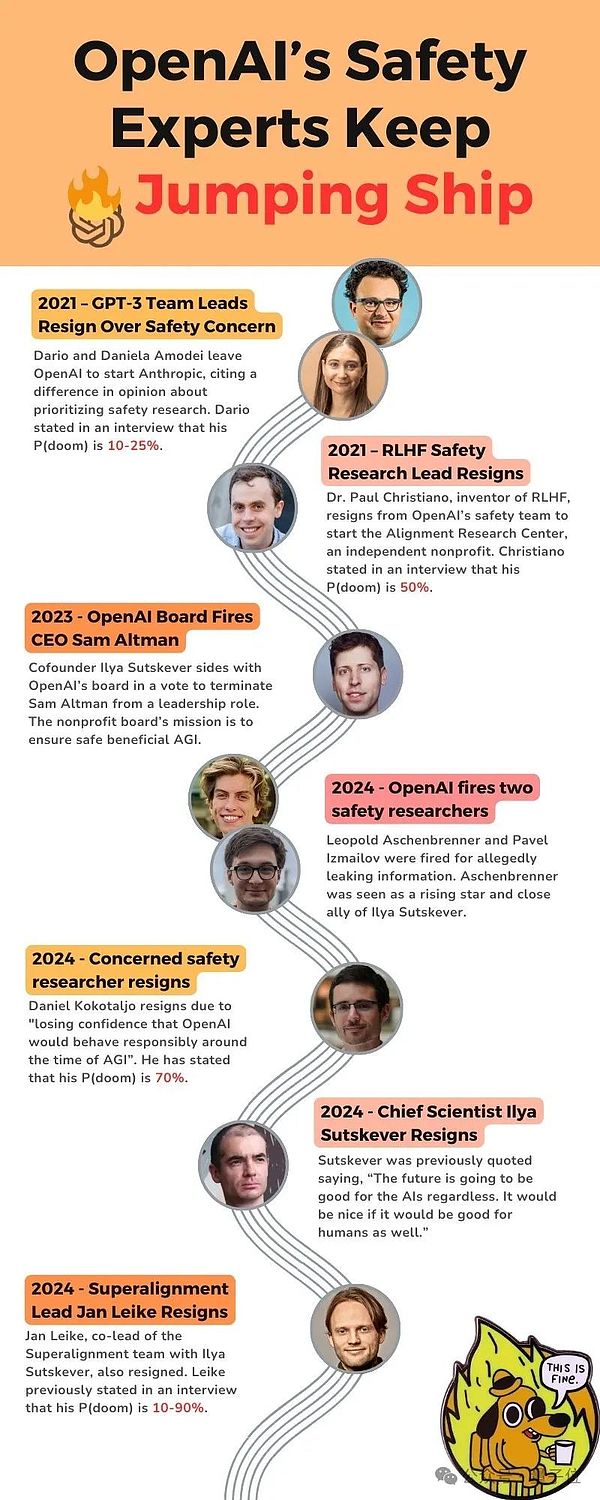

قام بعض مستخدمي الإنترنت بتصنيف العقد المهمة من الأشياء ذات الصلة التي حدثت في السنوات القليلة الماضية – أولا إعطاء تذكير مدروس ، كما هو مذكور أدناهP (Doom)، يشير إلى “إمكانية أن تؤدي الذكاء الاصطناعي إلى سيناريو يوم القيامة”.

في عام 2021 ، غادر رئيس فريق GPT-3 Openai بسبب مشكلات “السلامة” وأسس أنثروبور.

2021年,RLHF安全研究负责人离职,P(doom)为50%;

في عام 2023 ، قام مجلس إدارة Openai بإطلاق Ultraman ؛

في عام 2024 ، أطلق Openai اثنين من الباحثين الأمنية ؛

في عام 2024 ، كان باحث Openai قلقًا بشكل خاص بشأن الأمن المتبقي ، ويعتقد أن P (Doom) بالفعل بنسبة 70 ٪.

في عام 2024 ، استقال إيليا وجان ليك.

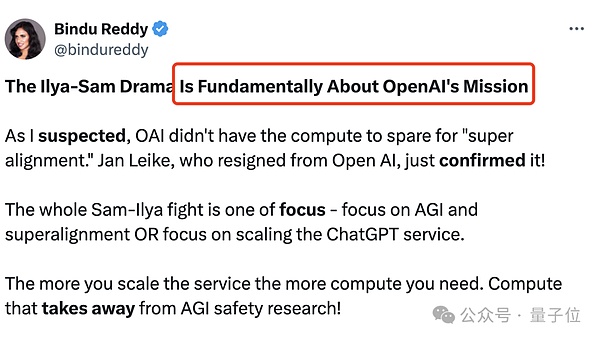

تقنية أم السوق؟

منذ تطوير النموذج الكبير ، “كيفية تنفيذ AGI؟”

المدرسة الفنيةآمل أن تكون التكنولوجيا ناضجة ويمكن التحكم فيها ثم تطبيقها ؛سوقمن المعتقد أنه أثناء الانفتاح ، وصل تطبيق النهج “التدريجي” إلى النهاية.

هذا هو أيضًا الفرق الأساسي بين نزاع Ilya-Altman ، أي مهمة Openai:

ركز على AGI و Super Moalment ، أو التركيز على توسيع خدمات ChatGPT؟

كلما زادت خدمة chatgpt ، زادت مقدار الحساب المطلوب ؛

إذا كانت Openai هي مؤسسة غير ربحية مخصصة للبحث ، فيجب عليهم قضاء المزيد من الوقت في المحاذاة الفائقة.

انطلاقا من بعض التدابير الخارجية من قبل Openai ، من الواضح أن النتيجة ليست كذلك.إنهم يريدون فقط أن يأخذوا زمام المبادرة في مسابقة النموذج الكبير وتوفير المزيد من الخدمات للمؤسسات والمستهلكين.

في رأي إيليا ، هذا شيء خطير للغاية.حتى لو لم نعرف ما الذي سيحدث مع نمو المقياس ،في رأي Ilya ، أفضل طريقة هي أن تكون آمنًا أولاً.

مفتوح وشفاف حتى نتمكن من البشر من ضمان بناء AGI بأمان ، وليس بطريقة سرية.

لكن تحت قيادة Ultraman ، يبدو أن Openai لا يتابع المصدر المفتوح ولا المحاذاة الفائقة.بدلاً من ذلك ، كان الأمر كله يتعلق بالركض نحو AGI أثناء محاولة بناء خندق.

في النهاية ، كان اختيار عالم العلماء إيليا صحيحًا ، أو هل يمكن أن يذهب Ultraman ، وهو رجل أعمال في وادي السيليكون ، إلى النهاية؟

لا توجد طريقة لمعرفة الآن.ولكن على الأقل Openai يواجه خيارًا رئيسيًا الآن.

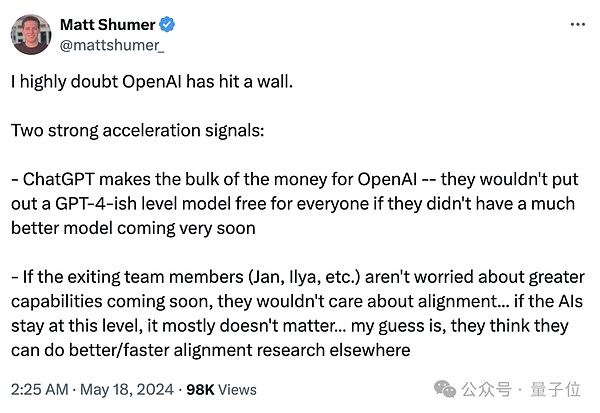

لخص بعض المطلعين على الصناعة إشارات رئيسية.

واحدإنه chatgpt ، الإيرادات الرئيسية لـ Openai.

آخرهذا هو ، إذا لم يكن أعضاء الفريق المستقيل (يناير ، إيليا ، إلخ) قلقين بشأن إمكانية وجود ميزات أكثر قوة قريبًا ، فلن يهتموا بالمحاذاة … إذا بقيت الذكاء الاصطناعي في هذا المستوى ، فهذا لا يهم بشكل أساسي .

لكن التناقض الأساسي لـ Openai لم يتم حله.

لم يعد الجانبين لا يمكن التوفيق بينهما ، ويتم القضاء على الفصيل العلمي تمامًا من Openai ، ولا يزال العالم الخارجي لا يعرف إلى أين وصل GPT؟

كان الأشخاص الذين كانوا حريصين على معرفة الإجابة على هذا السؤال متعبًا بعض الشيء.

وقال شعور بالعجز في قلبي ، كما قال هينتون ، معلم إيليا وأحد جوائز تورينج الثلاث:

أنا كبير في السن وأنا قلق ، لكن لا يمكنني فعل أي شيء حيال ذلك.

الرابط المرجعي:

[1] https://www.vox.com/future-perfect/2024/5/17/24158403/openai-resignations-aifety-ilya-sutskever-jan-leike-eike-artificial-intelligence

[2] https://x.com/janleike/status/1791498174659715494

[3] https://twitter.com/sama/status/1791543264090472660